张量(Tensor)这个词听起来可能有点高深,但其实它的本质并没有那么复杂。今天我们用通俗的语言来聊聊什么是张量,它与人工智能之间有什么关系,以及为什么张量对现代科技如此重要。

一、什么是张量?

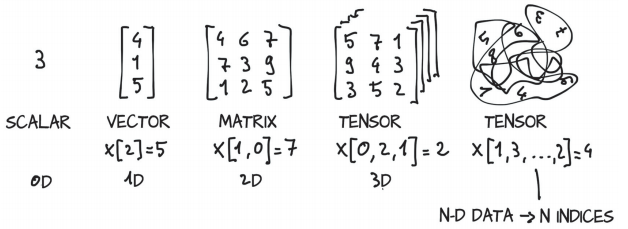

首先,我们从生活中的简单例子出发。你可以把张量理解为一种多维的“数据盒子”。

- 标量(0维张量)

想象一下你手里有一个数字,比如 5。这个数字就是一个标量,它只有一个值,没有方向和维度。 - 向量(1维张量)

如果你列出一组数字,比如 [2, 4, 6],这就是一个向量。你可以把它看成是一个“排成一行”的数据盒子,表示一个方向上的数据。 - 矩阵(2维张量)

再往复杂一点想象,假如你写出一个表格,比如:复制代码1 2 3 4 5 6 7 8 9这个表格里的数字排成了行和列,构成了一个二维的“数据盒子”,也就是矩阵。 - 高维张量

如果你继续加更多的维度,比如每个表格再叠一层,类似一本“数据书”,那就是更高维的张量了。对于机器学习和人工智能来说,张量可以有三维、四维,甚至更高维度。

通俗点讲,张量就是一种装载数据的容器,它能表示从一个数字到复杂多维数组的各种数据结构。

二、张量在人工智能中的角色

现在我们知道张量是用来表示数据的,那它跟人工智能又有什么关系呢?人工智能,尤其是深度学习的核心,其实就是处理和操作大量数据。而这些数据通常是以张量的形式存在的。

1. 输入数据是张量

无论是图片、语音、文本还是其他类型的数据,最终都会转化成数字。

- 图片:一张图片可以看成是由像素点组成的,每个像素都有一个颜色值。比如彩色图片会有三层(红、绿、蓝),每层都是一个矩阵叠起来,形成一个三维张量。

- 语音:语音是声音信号,可以转化成时间和频率的矩阵表示,也是一种张量。

2. 深度学习模型处理的是张量

神经网络的本质就是一连串的数学运算,而这些运算都作用在张量上。

- 张量在网络中流动,从输入层到隐藏层,再到输出层,模型通过一系列的操作,比如矩阵乘法、非线性变换等,不断“加工”张量里的数据。

- 神经网络“学习”的过程,其实就是调整这些运算的参数,让输出的张量更接近目标结果。

3. 输出数据也是张量

模型的输出结果,比如图片分类的概率、语音识别的文字、甚至生成的新图像,最后都是通过张量的形式表示的。

三、张量背后的魔法:框架和硬件

深度学习的成功,离不开张量的高效运算。而这得益于以下两方面:

1. 张量计算框架

像 TensorFlow 和 PyTorch 这样的框架专门为张量运算设计。你可以把它们看成是“数学工厂”,专门为你处理复杂的张量计算。它们提供了大量的工具,让开发者可以轻松地对张量进行操作,而不用关心底层的实现细节。

2. 硬件加速

处理张量运算需要大量的计算资源。幸运的是,GPU(图形处理单元)和 TPU(张量处理单元)是专门为这种任务设计的。

- GPU:它的并行计算能力特别适合处理大规模张量运算,比如矩阵乘法。

- TPU:这是 Google 专门为张量计算设计的芯片,比传统 GPU 更高效。

四、张量为何重要?

张量不仅仅是人工智能的核心数据结构,它更是连接数学和实际应用的桥梁。以下是它的重要性:

- 灵活性

张量能表示各种不同的数据结构,比如时间序列、空间图像和图结构数据。无论你的数据有多复杂,都可以用张量来统一表达。 - 高效性

通过优化的数学运算,张量可以在现代硬件上以极高的效率处理,为深度学习模型提供了强大的计算能力。 - 通用性

张量不仅在人工智能中使用,还在物理学、工程学、甚至金融领域都有应用。它是一种通用的数据表示方法。

五、总结:张量推动人工智能的未来

张量之所以在人工智能中扮演如此重要的角色,是因为它能高效地表示和处理数据,同时与深度学习模型的运作方式完美契合。没有张量,我们就无法以今天这样的效率训练模型,生成像 ChatGPT 这样的智能系统,或者创造令人惊艳的 AI 图像生成技术。

所以,下次听到“张量”这个词时,不用觉得高深莫测。你只需要记住,它就是一个能装载各种数据的“盒子”,是人工智能背后强大的数据表达工具。